Yerel, kişisel ve gelişmiş AI sohbet robotu: Nvidia Chat with RTX

ChatGPT veya Copilot’u mutlaka en az bir kere kullanmışsınızdır. Eğer kullanmışsanız ne kadar da hantal olduklarını deneyimlemişsinizdir. Basit bir “merhaba” sorgusuna yanıt almak için bile 5-10 saniye beklemek gerekebiliyor. Çok yoğun senaryolarda yanıtlar 30 saniye kadar geç gelebiliyor. Ancak yerel olarak çalışan bir yapay zekada bu gecikmeler yaşanmıyor. Nvidia RTX ile Sohbet, bu sayede gecikmelerin hiçbirini yaşamıyor.

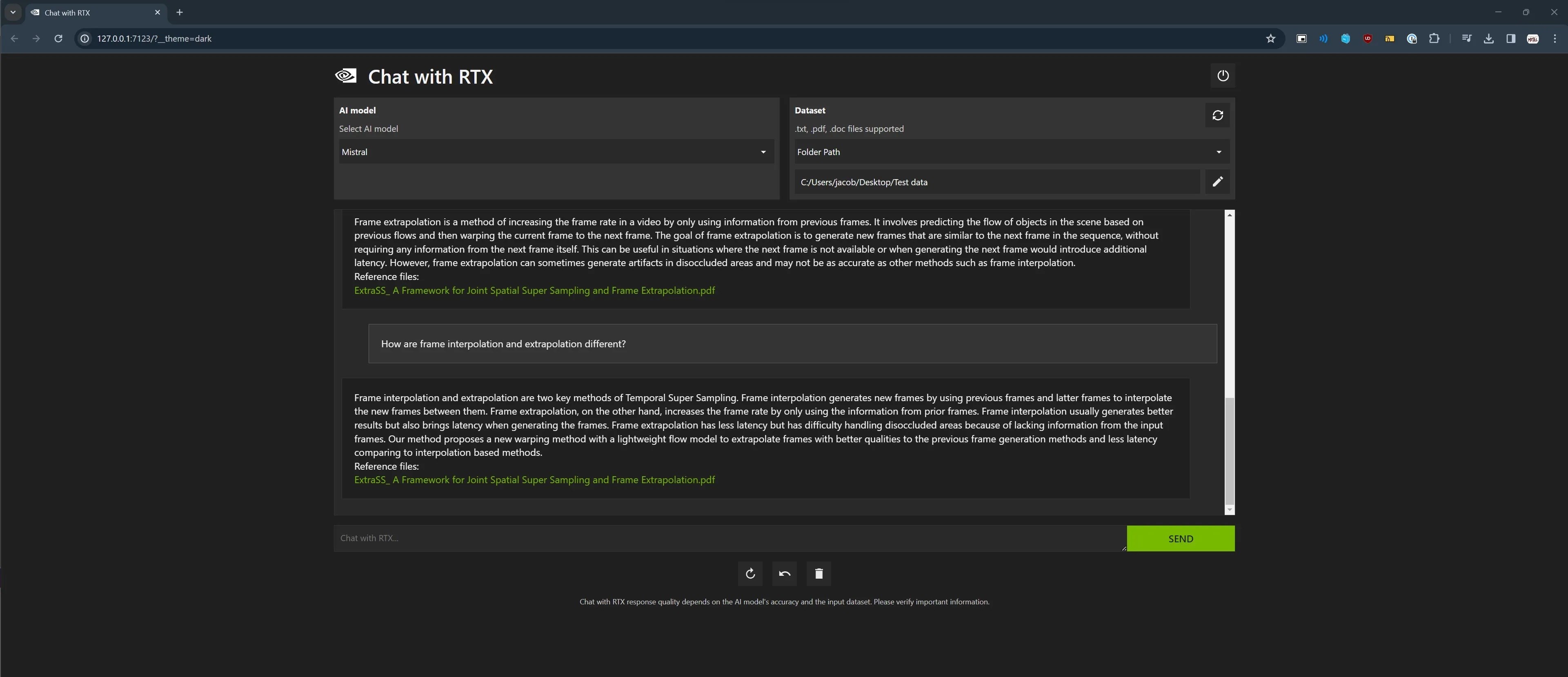

Şirket, kullanıcıların bilgisayardaki yerel dosyalarını veri kümesi olarak Mistral veya Llama 2 gibi açık kaynaklı büyük bir dil modeline hızlı ve kolay bir şekilde bağlamasına olanak tanıdığını söylüyor. Böylece alakalı sorgularınızda yazılım cevabı bulmak için yerel dosyaları tarıyor ve saniyeler içinde anında yanıtını veriyor.

Bu, kişisel verilerinizin bağlamsal çerçevesi içinde çalışan gerçek bir dijital asistana benzeyen bir şeye doğru büyük bir adım gibi görünüyor. Çoğu sohbet robotunda veriler buluta gönderiliyor, ancak Chat with RTX, kullanıcıların hassas verileri üçüncü bir tarafla paylaşmadan veya internet bağlantısına gerek kalmadan yerel bir bilgisayarda işlemesine olanak tanıyor. Yani daha güvenli ve bağlamsal olarak daha bilinçli.

Sorunlar yok değil

RTX 4090 GPU'ya sahip Intel Core i9-14900K işlemciyle çalışan bir bilgisayara RTX ile Sohbet'i yüklemek yaklaşık 30 dakika sürüyor. Uygulama yaklaşık 40 GB boyutunda ve Python örneği 64 GB RAM'li bir sistemde 3 GB alan kaplıyor.

Sınırlamalar tarafında ise çok fazla hatanın olduğu belirtiliyor. Sistem bazen YouTube videolarını doğru analiz edemiyor, çok sayıda dosya yüklendiğinde çökebiliyor, halüsinasyon yaşayabiliyor. RTX ile Sohbet bağlamı da hatırlamıyor, bu nedenle takip soruları önceki bir sorunun bağlamına dayanamıyor.

Yine de bu ileriye atılmış büyük bir adım. Özellikle kişisel dosyalarınızı analiz etmek için Copilot Pro veya ChatGPT Plus gibi bir şeye abone olmak istemiyorsanız, yapay zekalı bir sohbet robotunun gelecekte bilgisayarınızda yerel olarak neler yapabileceğini gösteriyor.

Kaynakça https://www.engadget.com/nvidias-new-ai-chatbot-runs-locally-on-your-pc-163406121.html https://www.theverge.com/2024/2/13/24071645/nvidia-ai-chatbot-chat-with-rtx-tech-demo-hands-on Bu haberi, mobil uygulamamızı kullanarak indirip,istediğiniz zaman (çevrim dışı bile) okuyabilirsiniz:

İnce Satırlar

İnce Satırlar Liste Modu

Liste Modu Döşeme Modu

Döşeme Modu Sade Döşeme Modu

Sade Döşeme Modu Blog Modu

Blog Modu Hibrit Modu

Hibrit Modu