Nvidia oyuncu tarafında önemli bir güce sahip olsa da yapay zekâ teknolojilerine yaptığı yatırımlar takdire şayan. Oyuncu kartlarında bu yatırımların görsel anlamda yansımasını görebiliyoruz ancak sunucu tarafında işler çok farklı boyutlara ulaşıyor.

Nvidia Hopper mimarisi nedir?

Yapay zekâ tabanlı sunucu sistemleri ve otomotiv sistemleri için yıllardır teknolojiler geliştiren Nvidia pek çok yenilikçilik ödülüne layık görüldü. Bir kutu içerisine süper bilgisayar sığdırmak gibi yetenekleri olan firmanın geliştirdiği yapay zekâ sistemleri döneminin çok ötesinde. Şimdi bu teknolojiler bir adım daha ileriye taşınıyor.

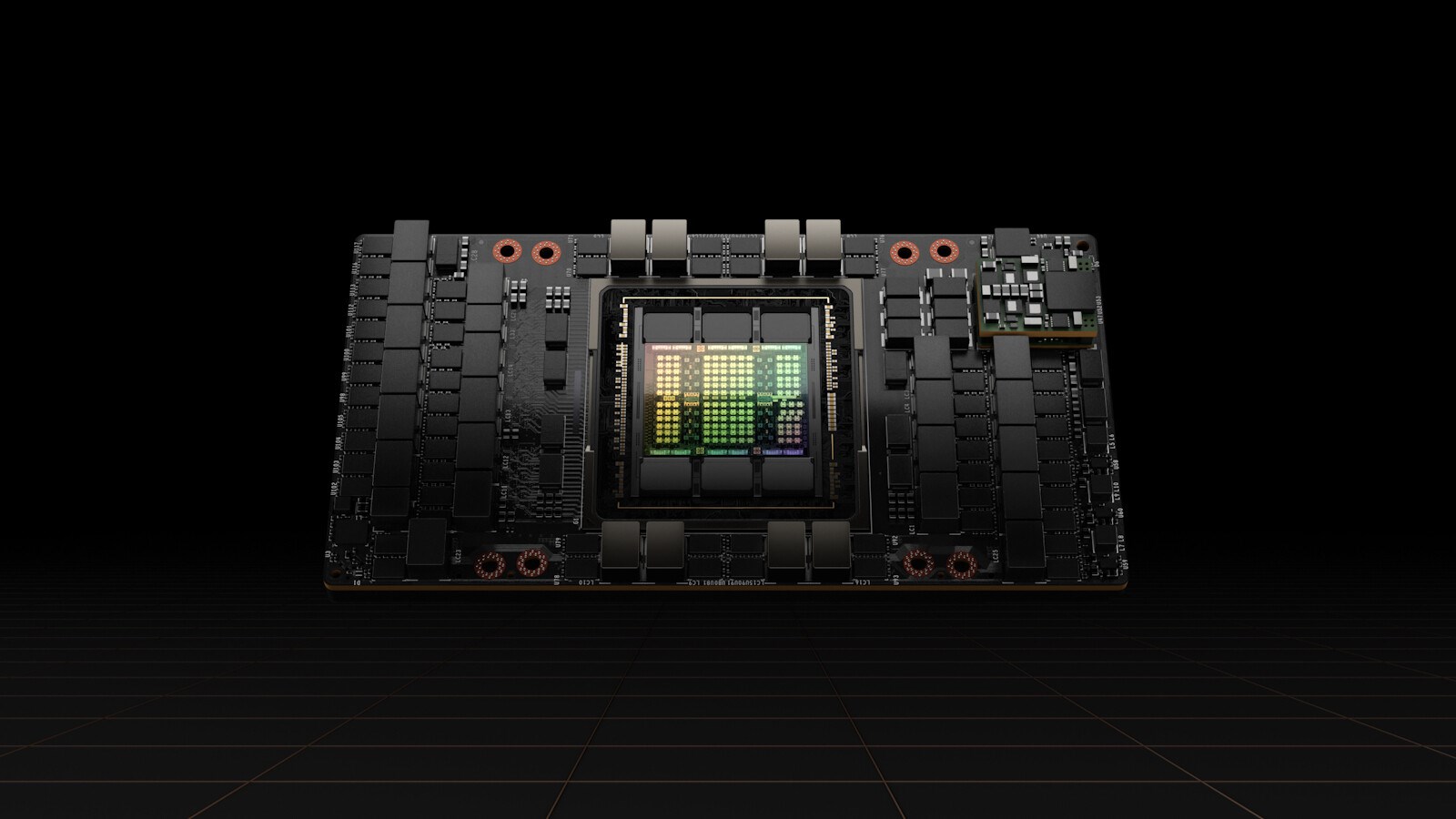

Bir süredir internete sızdırılan Nvidia Hopper sunucu mimarisi bugün resmiyete kavuştu. Hopper ismi ise bilgisayar bilimlerinin büyük ismi Grace Hopper’a atfedildi. Tahminlerin aksine 80 milyar transistör barındıran Nvidia H100 çekirdeği dünyanın en büyük ve güçlü hızlandırıcısı konumunda.

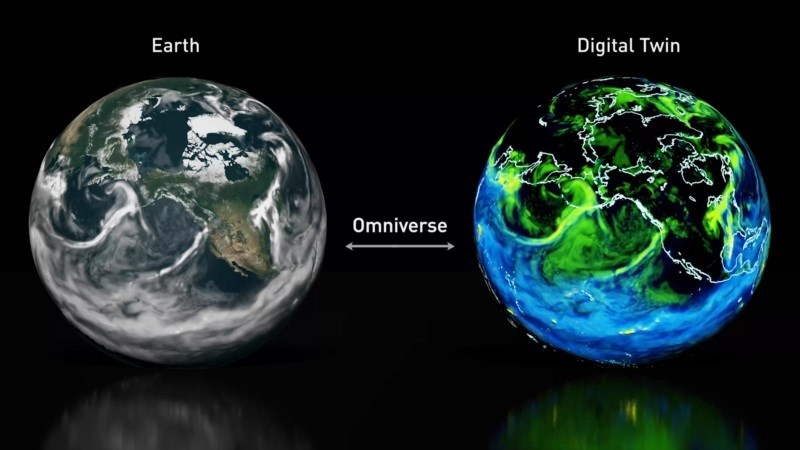

Ağırlıklı olarak yapay zekâ ile uğraşan genom çalışmaları, meteoroloji, otonom öğrenme dilleri, kompleks dijital ikizleme gibi sektörlere hitap ediyor. TSMC tarafından 4nm sürecinde üretilen H100 ilk HBM 3 bellek ve PCIe 5.0 kullanan grafik birimi ünvanına sahip.

5Tb/s olarak harici bağlantı hızları sunan birim 3TB/s bant genişliğine ulaşıyor. 20 adet H100 grafik biriminin tüm dünyanın internet trafiğini üstelenebileceği gibi ekstrem bir iddia mevcut. Böylece büyük dil modelleri ve gelişmiş tavsiye sistemleri veri üzerinde gerçek zamanlı çalışabilecek.

Tek bir grafik çekirdeği çoklu örnekleme yazılım sayesinde yedi küçük ve tam olarak izole edilmiş örneklere çoğaltılabiliyor. Yapay zekâ modelleri işlenirken koruma sunan güvenilir bilişim çözümü de ilk kez bu grafik biriminde yer alıyor. Kaynaklar TDP değerinin 700W civarında olduğunu belirtmiş.

Dördüncü nesil Nvidia NVLink teknolojisi yeni anahtar çözümü sayesinde 256 adet H100 hızlandırıcısını 9 kat daha yüksek bant genişliğinde bağlayabiliyor. Yeni DPX dinamik programlama komut seti ise rakip sistemlere göre 40 kat daha hızlı işlem yapabiliyor. Robotik sistemlerin en optimal rota bulması için geliştirilen Floyd-Warshall sistemi ve DNA sekans algoritması Smith-Waterman bunlar arasında.

Nvidia’nın derin öğrenme iş istasyonu serisi DGX yeni mimariye de hazır. DGX H100 istasyonu 8 adet H100 çekirdeği barındırıyor. Her çekirdek yeni NVLink ile 900GB/s hızında bağlanıyor. Harici NVLink çözümü ise 32’ye kadar DGX H100 istasyonunu birbirine bağlıyor ve DGX SuperPOD süper bilgisayarı ortaya çıkıyor. SXM devre kartı tarzındaki H100 ve PCIe kartı tarzındaki H100 hızlandırıcıların ikisi de yeni NVLink kullanımına uygun. Alibaba Cloud, Amazon Web Services, Baidu AI Cloud, Google Cloud, Microsoft Azure gibi pek çok önemli müşteri şimdiden H100 hızlandırıcı sistemleri için siparişlerine başladı.

Bu haberi, mobil uygulamamızı kullanarak indirip,istediğiniz zaman (çevrim dışı bile) okuyabilirsiniz:

İnce Satırlar

İnce Satırlar Liste Modu

Liste Modu Döşeme Modu

Döşeme Modu Sade Döşeme Modu

Sade Döşeme Modu Blog Modu

Blog Modu Hibrit Modu

Hibrit Modu

1 Kişi Okuyor (0 Üye, 1 Misafir) 1 Masaüstü GENEL İSTATİSTİKLER

7035 kez okundu.

10 kişi, toplam 12 yorum yazdı.

HABERİN ETİKETLERİ

nvidia hopper, nvidia ve